Deze publicatie maakt deel uit van een serie over hoe kunstmatige intelligentie het testvak opnieuw uitvindt.

Origineel artikel staat op de Praegus Substack: https://buggedorblessed.substack.com/p/voorbij-automatisering-de-nieuwe-101

Misschien weet je nog niet precies waar je moet beginnen met AI in je testwerk. En eerlijk is eerlijk: zodra je termen hoort als MCP servers of AI Agents, lijkt het al snel een technisch mijnenveld waar je diep in moet duiken. Toch hoeft het helemaal niet zo ingewikkeld te zijn.

De kracht van AI zit hem vaak niet in complexe infrastructuren, maar juist in eenvoudige stappen. Je kunt vandaag al beginnen door simpelweg beter gebruik te maken van prompts. Stel AI een vraag over je testscripts, laat het een testidee genereren of een user story analyseren. Kleine experimenten kunnen verrassend veel inzicht geven en vormen de perfecte opstap naar grotere, meer geavanceerde toepassingen.

Onderkant formulier

Kortom: begin niet met de moeilijkste techniek, maar met de slimste stap. Eén goede prompt kan al het begin zijn van een hele nieuwe manier van testen.

Teveel tekst? Ga direct naar de video.

Wanneer is een prompt goed?

Een handige manier om betere prompts te schrijven, is door de vier kernonderdelen te gebruiken die samen het acroniem CARE vormen:

- Context: Beschrijf de situatie of achtergrond waarin je werkt.

- Ask: Geef duidelijk aan wat je wilt dat de AI doet.

- Rules: Voeg eventuele beperkingen of richtlijnen toe waaraan het antwoord moet voldoen.

- Examples: Laat met voorbeelden zien wat je bedoelt of welk format je verwacht.

CARE helpt je om gestructureerd te denken, maar het is geen vaste volgorde die je altijd moet aanhouden. Niet elke prompt hoeft even uitgebreid te zijn. Voor algemene vragen of snelle ideeën is een korte prompt vaak al voldoende. Maar als je complexe of specifieke resultaten verwacht, bijvoorbeeld een teststrategie testrapport of codevoorbeeld, loont het om meer context en regels mee te geven.

Uitwerking Care voor het genereren van testcases.

Context

Ik werk als softwaretester aan een webapplicatie met een standaard login-scherm. Gebruikers voeren hun e-mail en wachtwoord in om toegang te krijgen. Er zijn validaties op invoervelden, foutmeldingen bij onjuiste invoer, en een functie voor wachtwoord-herstel.

Ask:

Genereer een lijst met testideeën voor deze login-functionaliteit, gericht op zowel positieve als negatieve scenario’s.

Rules:

- Gebruik duidelijke, beknopte zinnen.

- Groepeer de testideeën per categorie (validatie, beveiliging, gebruiksvriendelijkheid).

- Geef geen code, alleen testideeën.

Examples:

- Controleer dat het systeem een foutmelding toont bij een ongeldig e-mailformaat.

- Test of de gebruiker wordt doorgestuurd naar de juiste pagina na succesvolle login.

Playwright prompts

Natuurlijk willen we niet alleen testcases genereren en kunnen we dit principe ook toepassen op test automation:

Context

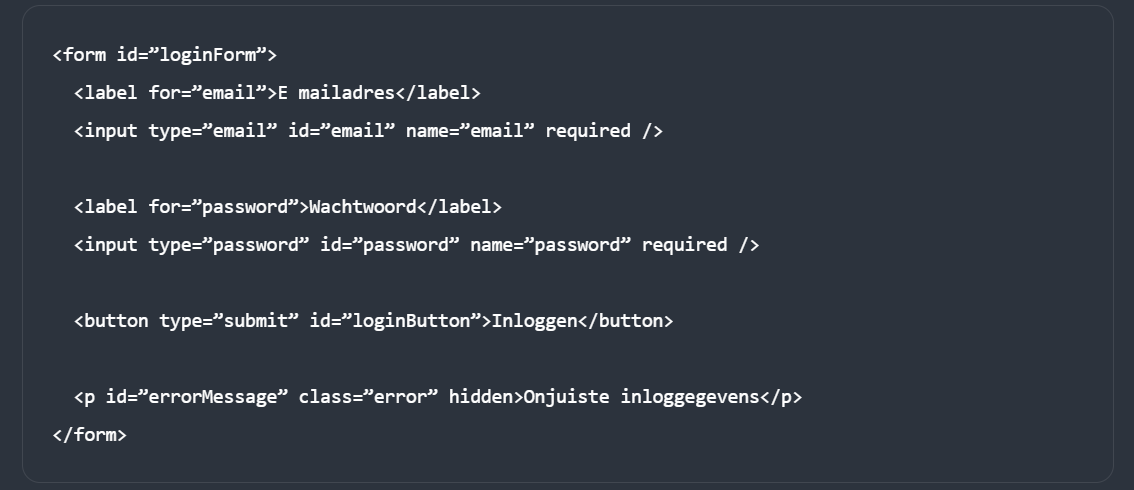

Ik werk als softwaretester aan een webapplicatie met een standaard login-scherm:

Ask

Controleer dat een gebruiker met geldige inloggegevens kan inloggen en dat de applicatie daarna het dashboard toont.

Rules

- De pagina /login moet volledig geladen zijn voordat er wordt ingevuld.

- Beide velden zijn verplicht. Lege invoer mag niet worden geaccepteerd.

- Alleen de combinatie van een bestaand e mailadres en het juiste wachtwoord mag leiden tot een redirect naar het dashboard.

- Bij foutieve gegevens moet het element #errorMessage zichtbaar worden.

- Na een succesvolle login wordt de gebruiker doorgestuurd naar /dashboard en moet er een zichtbare indicatie zijn dat de gebruiker ingelogd is. Bijvoorbeeld een element met tekst Welkom of een profielmenu.

Examples

- Geldige gegevens

- invoer e mail: tester@example.com

- invoer wachtwoord: Correct123

- verwacht: formulier wordt verstuurd, browser gaat naar /dashboard, element met tekst Welkom is zichtbaar

- Ongeldig wachtwoord

- invoer e mail: tester@example.com

- invoer wachtwoord: Fout123

- verwacht: gebruiker blijft op /login, element #errorMessage is zichtbaar met tekst “Onjuiste inloggegevens”

- Leeg e mailveld

- invoer e mail: leeg

- invoer wachtwoord: Correct123

- verwacht: formulier wordt niet verstuurd, browser blijft op /login, er verschijnt een validatieboodschap bij het e mailveld

- Leeg wachtwoordveld

- invoer e mail: tester@example.com

- invoer wachtwoord: leeg

- verwacht: formulier wordt niet verstuurd, browser blijft op /login, er verschijnt een validatieboodschap bij het wachtwoordveld

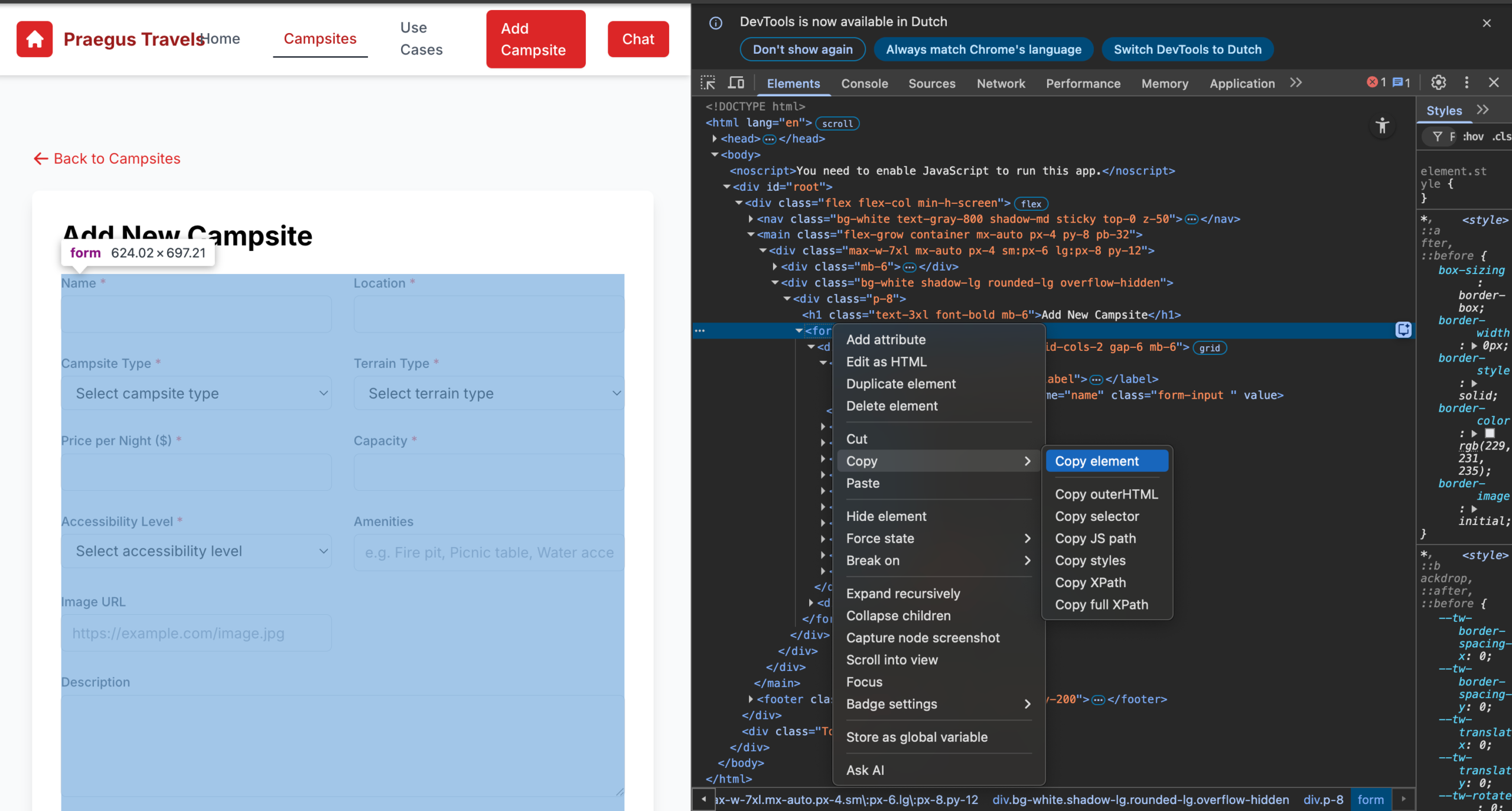

Maar hoe kan ik dan de HTML meegeven in mijn context?

Ook dit is niet zo ingewikkeld als het lijkt. Haal simpel de HTML op uit de ontwikkelaarstools van je browser. Je kunt de ontwikkelaarstools van de browser openen met de F12-toets in de meeste browsers, of met de sneltoets Ctrl+Shift+I (Windows/Linux) of Cmd+Option+I (Mac).

Je kunt dit ook doen via het menu van de browser: klik met de rechtermuisknop op de pagina en kies Inspecteren, of ga in het hoofdmenu naar Meer hulpprogramma’s en selecteer daar Ontwikkelaarstools. Hover met je muis door de html en kopieer het element wat je wilt gebruiken in je prompt.

Let op, het aantal tokens in je prompt is beperkt dus kopieer alleen de relevante delen voor je test. Als je een formulier gaat testen hoef je je prompt bijvoorbeeld geen context mee te geven over het menu.

Samenvatting

Ging het toch nog wat te snel? Bekijk dan ook de video met de bovenstaande stappen. Vergeet nooit de output van je LLM te controleren. Wat test je nu eigenlijk en dek je echt de risico’s af die je wilt testen? Als tester blijf jij altijd in control.

https://www.loom.com/share/bca3d5e5bf854c7986a1e96ab1f03def

Over deze serie

Deze publicatie maakt deel uit van de reeks Voorbij automatisering: de nieuwe rol van de tester in het AI-tijdperk — een serie over hoe kunstmatige intelligentie het testvak opnieuw uitvindt.

In elke aflevering verken ik een ander facet van deze verschuiving: van AI-geletterdheid en nieuwe testvaardigheden tot ethiek, data en de rol van menselijke intuïtie in een steeds slimmer ecosysteem.

De komende edities gaan een stap verder, met praktische demo’s van AI-gedreven testautomatisering, real-world voorbeelden van Mastra-agents in GitLab-pipelines en evaluatie-frameworks zoals Promptfoo.

Verwacht geen theorie alleen, maar concrete experimenten die laten zien hoe testers AI kunnen inzetten om kwaliteit tastbaar te maken.

De serie nodigt testers, ontwikkelaars en kwaliteitscoaches uit om na te denken over één centrale vraag:

Wat betekent kwaliteit nog in een wereld waarin AI meedenkt?

Nieuwsgierig geworden en wil je meer weten over testen? Neem dan contact op met Praegus – 085-1305977 / info@praegus.nl of kijk op www.praegus.nl